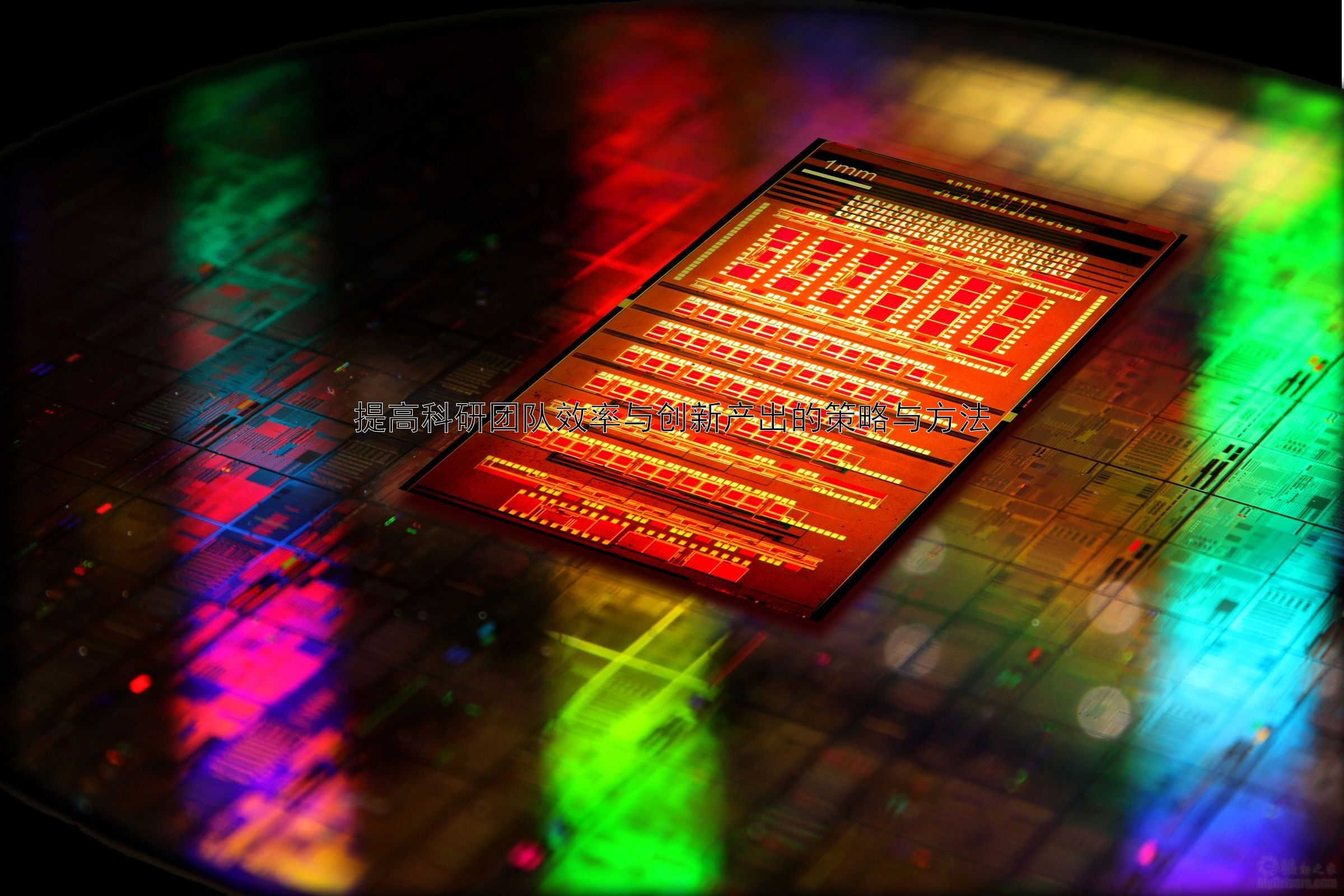

在当今数字化时代,人工智能(AI)技术的迅猛发展,尤其是深度学习领域的突破,使得各行各业都开始探索如何将这一先进的技术应用于自身的业务中。然而,随着模型复杂度的增加和数据量的爆炸式增长,传统计算架构的性能瓶颈逐渐显现出来。为了解决这些问题,一种名为“人工智能加速器”的新型硬件应运而生。本文将深入探讨这些专为高效处理AI工作负载而设计的芯片技术及其背后的行业领导者。

什么是人工智能加速器?

人工智能加速器是一种专门设计用于加速机器学习和深度学习算法运行速度的硬件设备。它们通过优化底层结构来提高AI模型的训练和推理效率,从而显著缩短了处理时间并降低了成本。目前市场上的人工智能加速器主要分为两大类:GPU(Graphics Processing Unit,图形处理器)和专用ASIC(Application-Specific Integrated Circuit,专用集成电路)。

GPU——通用加速方案

GPU最初是为图形渲染任务而开发的,但随着NVIDIA等公司对CUDA编程框架的支持,GPU已经成为了通用计算领域的重要角色。由于其多核心结构和并行计算能力,GPU非常适合于大规模矩阵运算,而这正是深度学习的基本操作之一。因此,GPU被广泛应用于构建AI平台,如Google的TensorFlow和Facebook的PyTorch。

ASIC——定制化解决方案

与GPU相比,ASIC是针对特定应用场景进行了高度优化的芯片。它们通常具有更高的能效比和更快的处理速度,因为它们的设计就是为了执行特定的任务。例如,谷歌的TPU(张量处理单元)就是一款著名的ASIC产品,它专为谷歌的TensorFlow生态系统中的深度学习工作负载而设计。其他知名的ASIC供应商还包括寒武纪科技(Cambricon Technologies)和华为海思半导体(HiSilicon Technologies Co., Ltd.)等中国公司。

人工智能加速器的市场格局

在全球范围内,人工智能加速器市场呈现出竞争激烈的态势。除了上述提到的NVIDIA、谷歌之外,还有许多企业也在积极布局这一领域。以下是一些在该市场中表现突出的公司及它们的代表性产品:

- NVIDIA Corporation - GeForce RTX系列GPU、Quadro系列专业级GPU以及面向数据中心应用的Tesla V100/A100 GPU。

- Advanced Micro Devices (AMD) Inc. - Radeon Instinct MI系列GPU,适用于高性能计算和AI工作负载。

- Intel Corporation - Xeon Scalable processors搭配Nervana神经网络处理器(NNP)或Movidius视觉处理器(VPU)。

- Google LLC - TPU v2和v3,主要用于支持自家的Google Cloud AI服务。

- Baidu -昆仑X200芯片,这是百度自主研发的云端全功能AI加速卡。

- Alibaba Group Holding Limited -含光800(SunGpu NPU),阿里巴巴推出的首款AI推理芯片。

- Huawei Technologies Co., Ltd. - Ascend(昇腾)系列AI处理器,包括昇腾910和昇腾310。

未来发展趋势

展望未来,人工智能加速器芯片的发展趋势主要包括以下几个方面:

- 集成化和小型化:随着边缘计算需求的增加,更加小巧高效的AI芯片将成为主流。

- 软件定义的可重构性:能够灵活适应不同应用需求的新一代AI加速器将会受到欢迎。

- 生态系统的建设:围绕AI芯片开发工具链和服务平台的完善将进一步推动整个行业的创新和发展。

- 绿色节能:降低能耗、提升能源效率将是各厂商持续努力的方向。

结语

作为AI时代的基石,人工智能加速器芯片正在引领一场深刻的计算革命。在这场变革中,我们看到既有老牌巨头不断推陈出新,也有新兴势力迅速崛起。可以预见的是,在未来几年里,这个市场的竞争将愈发激烈,同时也将为全球产业升级和技术进步带来无限可能。

- 人工智能加速器芯片技术领航者探秘

- 2024人工智能引领广告营销变革的十大趋势

- 2024人工智能智能交通管理应用效果探索

- 应对多模态人工智能国防应用的对抗性攻击策略

- 聚焦未来:嘉实科技基金在人工智能等领域的投资策略

- 探索2024年:AI赋能气象预测的精准革命

- 人工智能赋能疾病预测与预防新篇章

- 2024大湾区科学论坛探索人工智能新见解

- 百度人工智能赋能家居未来

- 人工智能融合之道:多模态技术与人工智能的协同创新

- 人工智能赋能医疗资源优化

- 人工智能引领2024法务咨询新纪元:优势与挑战并存

- 2024年:人工智能革新农业生产的优势与挑战

- 2024人工智能加速器芯片研发公司概览

- 人工智能赋能文化创意科技基金展望2024

- 人工智能加速器芯片赋能无人作战系统现状前瞻